Ekspertsystemer

- En gren av AI-teknologien var de såkalte ekspertsystemene.

- Dette ble et populært forskningsfelt på 80-tallet, og ideen var å modellere en eller flere eksperters innsikt på et område.

- Med utgangspunkt i omfattende kunnskap skulle slike systemer analysere og resonnere rundt problemstillinger på feltet og gi beslutningsstøtte på linje med et en menneskelig ekspert kunne.

- I slike systemer var det to deler. En som modellerte selve kunnskapen og en som benyttet den til å finne svar og generere ny kunnskap.

- Det ble utviklet to språk, Prolog og Lisp, for å modellere og sette sammen kunnskap.

- Etter å ha vært omfattet av veldig stor interesse en periode viste det seg at det var vanskeligere enn tenkt å utvikle teknologien.

Definisjonen av intelligens er vanskelig nok. Så hva er egentlig kunstig intelligens?

Begrepet har sitt opphav fra 50-tallet, hvor tilgangen på datakraft var mikroskopisk.

Nå har vi enorm datakraft, og den er blitt billig. Men betyr det at den er intelligent? Eller betyr det at vi har klart å lage noe som er ekstremt raskt og dumt?

Drømmen om å skape intelligente maskiner begynte allerede hos de gamle grekerne, men det var først i det 20. århundre at vi nærmet oss målet.

Det var selvfølgelig datateknologien som gjorde det mulig. Godt hjulpet av science fiction-litteraturen med Karel Čapeks Rossums universelle roboter og mange flere. Ikke minst da Hollywood forelsket seg i roboter, begynte tankene å gå hos inspirerte forskere.

Selve begrepet kunstig intelligens ble formulert under et seks uker langt seminar på Dartmouth College i 1956. Noen av dem som var med var John McCarthy, Allen Newell, Marvin Minsky og Herbert Simon. De etablerte et godt samarbeid med hverandre og ledet feltet i tiår.

Les også: Superdatamaskinen Watson skal hjelpe sjefen med å fatte de rette beslutningene

Lærer selv

Målet med kunstig intelligens var ikke å lage noe som var likt menneskehjernen, men å lage systemer som fungerte etter noen av de samme prinsippene.

Det betyr at slike systemer ikke må være bundet av at en programmerer skriver programmet helt ferdig, men at systemet kan lære selv. Det sørger for sin egen kunnskap, og det må være adaptivt.

Inspirasjonen til slike systemer kommer naturlig nok fra biologien og hvordan evolusjonen er med å tilpasse organismer til skiftende miljø. De er også inspirert av hvordan hjernen behandler informasjon.

Les også: 5 spådommer om hvordan teknologi vil endre livene våre

Mer sanntid

Det var ikke så enkelt å bygge lærende systemer på 50- og 60-tallet. I dag er det mye enklere fordi vi har fått billige sensorer, som kan fortelle systemet om omgivelsene.

Det er også blitt enklere tilgang til en lang rekke andre datakilder. Moderne systemer kan i mye større grad delta i sanntid og trekke egne slutninger.

Et eksempel er et system som er beregnet til å klassifisere frukt og som kan identifisere en ny type frukt det aldri er presentert for ved å analysere alle de klassiske kjennetegnene på frukt og trekke en konklusjon.

Ideelt skal et AI-system være helt selvlærende, men det er forskjell på teori og praksis. Enn så lenge.

All erfaring viser at et helt selvstendig system ender opp med dårlig ytelse, eller lav intelligens om man vil. Det betyr ikke at AI er en blindgate.

Et system som får assistanse av en ekspert vil fungere mye bedre. For eksempel kan ingeniører som driver med konstruksjon få assistanse av et AI-system til å gjøre finjusteringer av det store systemet og dermed øke nøyaktigheten og spare tid.

Les også:

Over alt

I dag finner vi spor av AI på veldig mange områder. Smarttelefoner er et eksempel på at lærende systemer er tatt i bruk for å hjelpe folk i hverdagen. Mange av appene på en telefon registrerer det vi gjør og «lærer» oss å kjenne, slik at de kan foreslå relevante alternativer for oss.

Det er forholdsvis enkle lærende systemer, men de virker godt og er et eksempel på at det er teknologien som tilpasser seg menneske og ikke omvendt.

Etter hvert som lærende AI-systemer utvikler seg og blir mye mer avanserte, er det noen som tror at teknologien blir så avansert at den til slutt ser på mennesker som overflødige.

Dette synet har gått igjen i utallige framtidsromaner.

Det andre, og litt hyggeligere synet på fremtiden, er at teknologien blir mye mer avansert, men at den utspiller seg på en god og assisterende måte. Den vil bli mindre synlig for oss og vil fungere som umerkelige assistenter i hverdagen, hvor den overvåker det vi gjør for å assistere oss i alle livets situasjoner. Om vi ønsker det.

Les også: Google Maps lagrer hvert lille skritt du tar

Deep learning

En variant av AI er det som har fått betegnelsen «deep learning». Mange nettjenester har tatt i bruk slik kunnskap om oss som individer for å gi oss bedre svar.

Facebook bruker det for ikke å overvelde oss med informasjon fra hundrevis av venner.

I stedet analyseres alt vi ellers skulle mottatt opp mot kunnskap om hva systemet mener passer oss best. Poenget med slike systemer er at de skal lære oss å kjenne og fungere som en avansert sekretær som sorterer for oss. Lignende teknologi brukes av Netflix for å anbefale filmer.

Noen AI-baserte systemer trenger ikke mye datakraft, mens andre knapt kan få nok. Det å sortere bilder og kjenne igjen ansikter krever svært mye når det er snakk om enorme antall. Slike systemer er i bruk i avanserte sikkerhetsanvendelser. Er det snakk om noen få, som når vi tar bilder med mobiler og kamera, trengs det ikke mye.

Les også: Robot kan gjøre 3 av 4 McDonalds-kokker overflødige

Watson

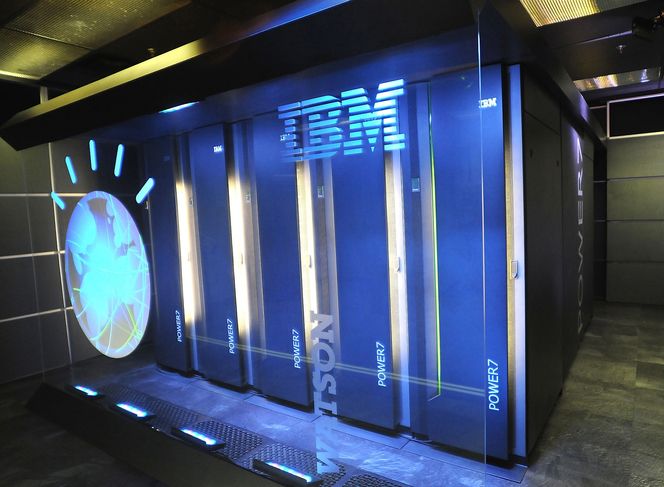

Den mest imponerende demonstrasjonen av noe som har lignet på kunstig intelligens er produsert av IBMs superdatamaskin Watson, som i 2011 vant spørrekonkurransen Jeopardy mot to amerikanske mestre. Systemet viste hvor langt man var kommet med maskinlæring.

Watson hadde selv «lest» hele Wikipedia og andre datakilder, men likevel er det kanskje ikke korrekt å kalle Watson intelligent. Systemet hadde én oppgave, mens en menneskelig hjerne må gjøre mange ting. Den må sørge for å styre pust og blodomløp, ha følelser og veldig mye annet som en maskin slipper.

Likevel er Watson et varsel om at maskinlæring og analyse er kommet så langt at vi kan får svært verdifull assistanse til vår mentale virksomhet.

Watson er tatt i bruk for å assistere i kreftbehandling, og mange andre felt står for døren. Kanskje slike systemer er en bedre definisjon av kunstig intelligens enn det vi har tenkt oss til nå.

Les også: Nå kan alle få en bit av superdatamaskinen Watson

Modellerer hjernen

Om ikke den tradisjonelle veien mot AI fører frem, tror noen at det å lage noe som er veldig likt vår biologiske hjerne skal bringe oss bedre AI. Det er prosjekter i gang både i USA og Europa, med Human Brain Flagship som det største, for å bygge modeller av hjernen i programvare og maskinvare.

Utfordringen er selvfølgelig at hjernen er uhyggelig kompleks med rundt 100 milliarder neuroner, som hver er koblet opp mot inntil 10.000 andre neuroner.

Å kjøre et slikt program, når det måtte bli ferdig, vil kreve en enorm datakapasitet. Mye større enn det som er praktisk på svært lenge ennå.

Løsningen kan ligge i å tenke helt nytt innen elektronikken. IBM arbeider med å bygge en hjernebrikke, som er bygget opp med noe som tilsvarer nevroner (hjernecellene) og synapser (koblingspunktene mellom dem).

Målet er å kunne lage en kunstig hjerne som behandler informasjon slik som vår egen, men som er svært mye mindre både i omfang og energibruk enn om hjernen skulle simuleres i programvare i en superdatamaskin.

Kilde: Professor ved Institutt for informatikk, UiO, Jim Tørresen og hans bok; Hva er kunstig intelligens (Universitetsforlaget, 2013)

Les også:

Norske fysikere vil gjøre PC-oppstarten lynkjapp