Datamaskiner blir raskere. Det er ikke noe nytt. Men på fartstoppen går det snart veldig mye raskere.

I 2020 ser Intel for seg en superdatamaskin som virkelig gjør vei i vellinga, enten vellinga er værmeldingen, klimamodeller, medisinsk diagnostikk, eller alle mulige fysiske modeller.

At værmeldinger er viktig vet jo alle som skal på hyttetur, men når vi vet at en tredjedel av amerikansk økonomi på en eller annen måte er avhengig av været, skjønner man at det er penger på spill.

Les også: Derfor blir værmeldingene feil

Exa i sikte

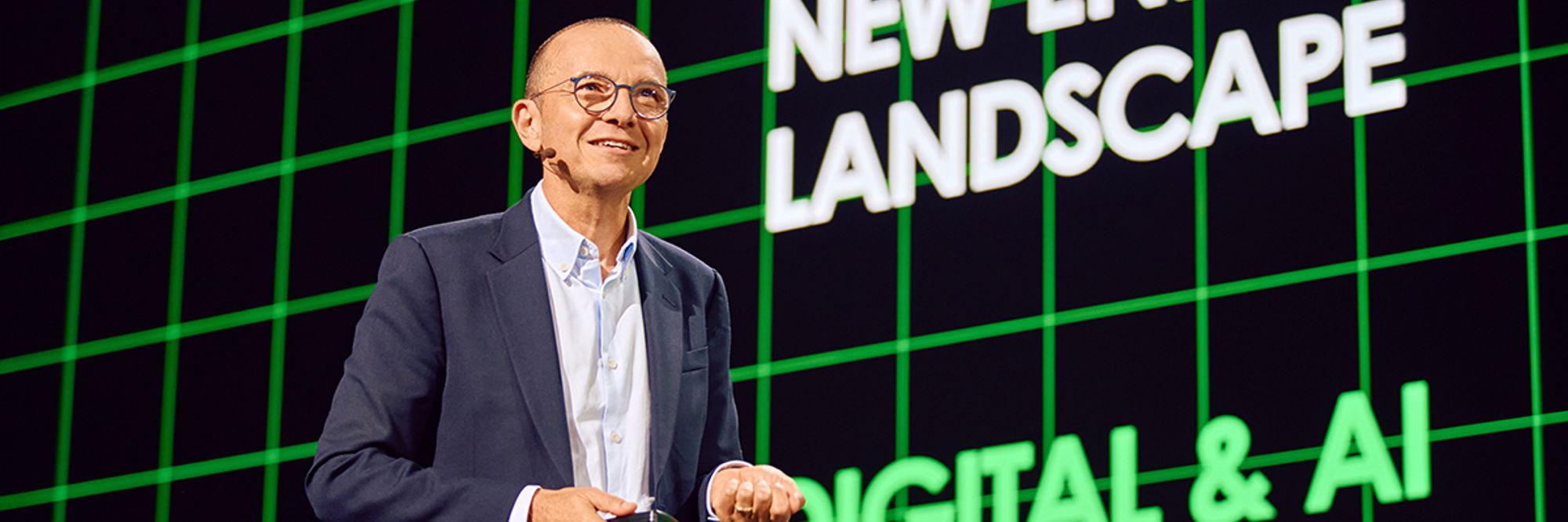

– I 2020 er det vårt mål å ha teknologi klar for å bygge superdatamaskiner som klarer en exaflop. Vi har bygget fundamentet for teknologien, men det gjenstår selvfølgelig veldig mye utvikling før i kommer dit, sier IT-arkitekt ved Intels datasentergruppe i Tyskland, Dr. Herbert Cornelius.

En Exaflop er 1018 flyttalloperasjoner i sekundet.

Til sammenlikning har en typisk PC-prosessor alt fra 15 til 90 Gflop/s. Altså 15 til 90 ganger 109 flyttalloperasjoner i sekundet.

De raskeste superdatamaskinene i dag er på 10 til 17 petaflops, altså 10 til 17 x 1915. Intels mål er derfor en maskin som er nesten 100 ganger raskere enn dagens toppmaskiner.

Les også: Verdens raskeste datamaskin

Bedre værmelding

– Det er selvfølgelig veldig mange ting som avgjør hvor god værmeldingen vil bli, men datakraft er ekstremt viktig i dag. Får vi en datamaskin som er hundre ganger raskere enn den vi bruker i dag, og som er på rundt 0,4 Petaflop/s, så vil værmeldingen bli mer nøyaktig. Vi kan regne igjennom flere alternativer raskere og vi kan bruke en mye finere geografisk oppløsning enn vi har i dag, sier forsker ved Meteorologisk Institutts forskningsavdeling, Morten Køltzow, og legger til at det forutsetter at de bruker mer data og utvikler modeller og programvare for å håndtere datakraften.

–Det vil gi oss større presisjon i alle ledd, men noe så komplekst som været vil vi neppe kunne spå perfekt på lang sikt. Til det er atmosfæren for kaotisk, sier han.

Les også: Se Googles hemmelige datasentre

Phi

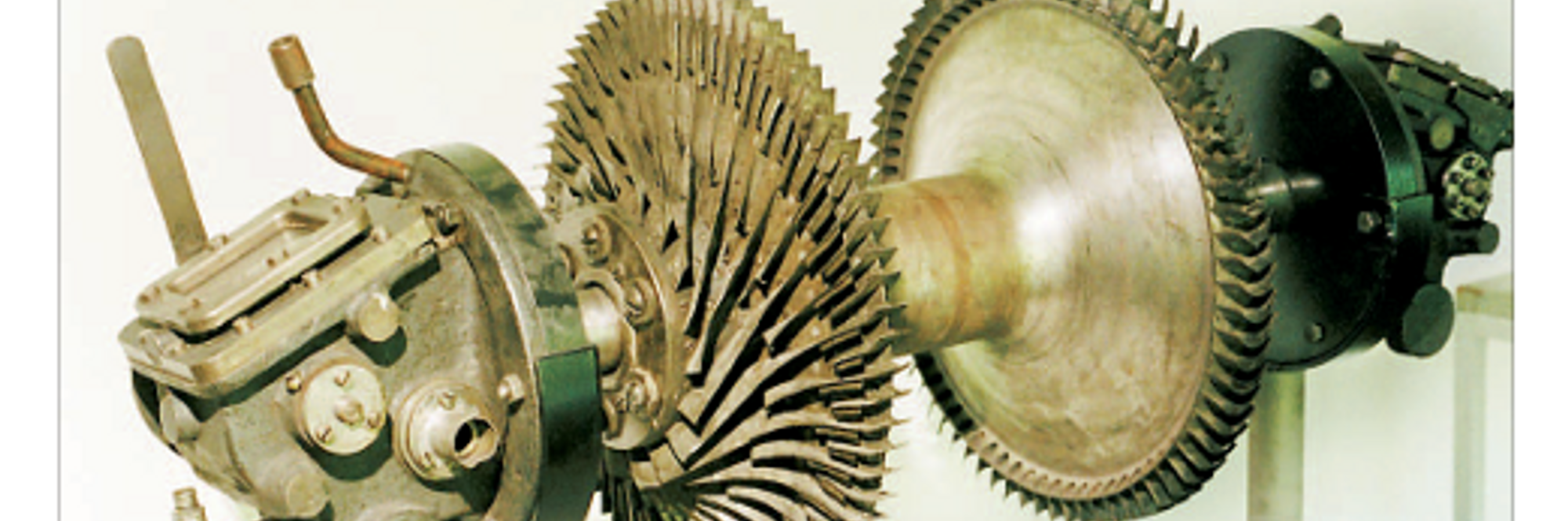

Intel har for alvor kastet seg over superdatamaskiner og utviklet en egen prosessor til dette bruket.

Xeon Phi er en prosessor med hele 61 kjerner, men hver av dem er forenklet og kjører med en lavere klokkefrekvens enn en vanlig Xeon.

Til gjengjeld har hver prosessor tilgang på 8 GB ekstremt raskt SRAM-minne som kan overføres med 320 GB/s.

Fremtidens Phi-prosessor vil ha langt flere kjerner og enda raskere minnekanaler.

Les også: Slik ble it-administratoren lurt for 500 millioner kroner

Lavere kraftforbruk

Når vi ser mot 2020, så skjønner vi at vi ikke kan øke kraftforbruket ut over det slike maskiner bruker i dag.

De kan bruke opptil 20 MW og det er umulig å tenke seg en hundredobling av et slikt forbruk. Kanskje vil vi til og med kunne senke det på tross av den voldsomme økningen i ytelse.

Utviklingen mot toppmaskiner med ekstrem ytelse vil også gi oss svært mye billigere superdatakraft. En maskin på en petabyte vil koste brøkdelen av den en tilsvarende maskin gjør i dag og bringe superdatakraft til langt flere.

Hva en exaflopmaskin vil koste er det ingen som vet, sier Cornelius.

Trenger ny programvare

En annen viktig faktor i jakten på superdatakraften er parallellbehandling av data.

– En slik maskin kan ikke behandle koden etter hverandre. Den må bruke alle prosessorene og få dem til å jobbe med ulike deler av datasettet samtidig. Jeg synes ikke dette har gått opp i tilstrekkelig grad for programvarefolk ennå. Skal de få glede av all datakraften vi gjør tilgjengelig, må de bli flinkere til å tenke parallellprogrammering. Programvaren må kunne håndtere en milliard ulike tråder i parallell, sier han.

Les også: Kan gjøre Europa uavhengig av GPS